Julien Auguste Hervè, «Ritratto di donna con mal di denti», olio su tela, 1900 circa.

[Mentre scrivevo la seconda parte del mio “portolano” Trecentonovantaquattro giorni (la prima è qui), alcune riflessioni su luoghi, corpi e scrittura hanno fatto reazione con recenti polemiche su letteratura e intelligenze artificiali. Quelli che dovevano essere due capoversi si sono allungati e sono diventati un testo a parte, fatto perlopiù di appunti, che vanno presi come tali, ma che ritengo utile pubblicare. A questo punto, la seconda parte di Trecentonovantaquattro giorni uscirà nei primi giorni del nuovo anno. Buona lettura. WM1]

«Quando restituisce un corpo, ecco: è poesia.»

Ottavio Fatica, Lost in translation

«Il capitale è il cancro di cui la specie rischia di morire prima di cominciare a vivere realmente. In questo senso, la rivoluzione è biologica»

Giorgio Cesarano, Manuale di sopravvivenza*

«Mentre l’intelligenza artificiale iper-appiattisce la cultura di massa, qualunque cosa mostri evidenze di umanità diventa qualcosa a cui aspirare.»

ANU, Aspirational Humanity

Qui potrebbero arrivarmi accuse di «antropocentrismo», balzane ma in voga tra gli apologeti dell’attuale modello di IA. Gente che quando va “bene” dà letture riduttive degli enormi problemi ecologici e climatici che quel modello esaspera, e quando va male – quasi sempre – li rimuove proprio dal quadro**.

La critica all’antropocentrismo è imprescindibile, ma ha senso solo se declinata in termini ecologici, a difesa degli ecosistemi viventi. L’antropocentrismo non è altro che specismo, ideologia del primato dell’Homo Sapiens sulle altre specie. Criticarlo, dunque, serve a riconoscere il vivente oltre l’umano.

Se invece si adotta una postura anti-antropocentrica per difendere un’entità non-vivente, una pseudosoggettività inorganica – in pratica, marxianamente, lavoro morto – intorno a cui si è costruito con tracotanza un modello industriale fra i più energivori, sperequatori di risorse ed ecocidi mai esistiti nel capitalismo, a sua volta il modo di produzione più ecocida mai esistito… Beh, qui si abusa della postura.

«Evidenze di umanità» lo intendo come: manifestazioni di resistenza del vivente. Di una corporeità che, a dispetto della sua fragilità o forse proprio grazie a essa, continua a rappresentare un limite, ma che per essere davvero un limite dovrà includere corporeità non umane. Per cominciare a vivere realmente, la nostra specie – come dice il dottor Stegagno – deve finalmente pensarsi come tale, cioè specie tra le altre. L’Homo che avrà fatto questo salto e avrà piena esperienza della comunanza tra specie è quello che Jacques Camatte chiama Homo Gemeinwesen. Gemeinwesen, essere comune, è un altro termine marxiano.***

È vero che le accuse di «antropocentrismo» trovano facili bersagli nel dibattito corrente sull’IA, quasi sempre mal posto e peggio sviluppato. Gli umanisti si stracciano le vesti: che ne sarà dell’Autore se l’IA può ormai «trarre in inganno» imitando lo «stile» di chiunque, anche del più geniale premio Nobel?

Ah, l’Autore, questo eroe di un suprematismo dentro il suprematismo… La sua sacra ispirazione che l’IA dissacra… Le sue res gestae così importanti…

La preoccupazione, naturalmente, è più venale: e se un giorno lettrici e lettori preferissero i libri scritti dalle IA a quelli scritti da esseri umani, e gli editori non avessero più bisogno di questi ultimi? Insomma, una sfilza di premesse sbagliate, false questioni e fallacie logiche, alimentate da un articolo uscito pochi giorni fa sul New Yorker.

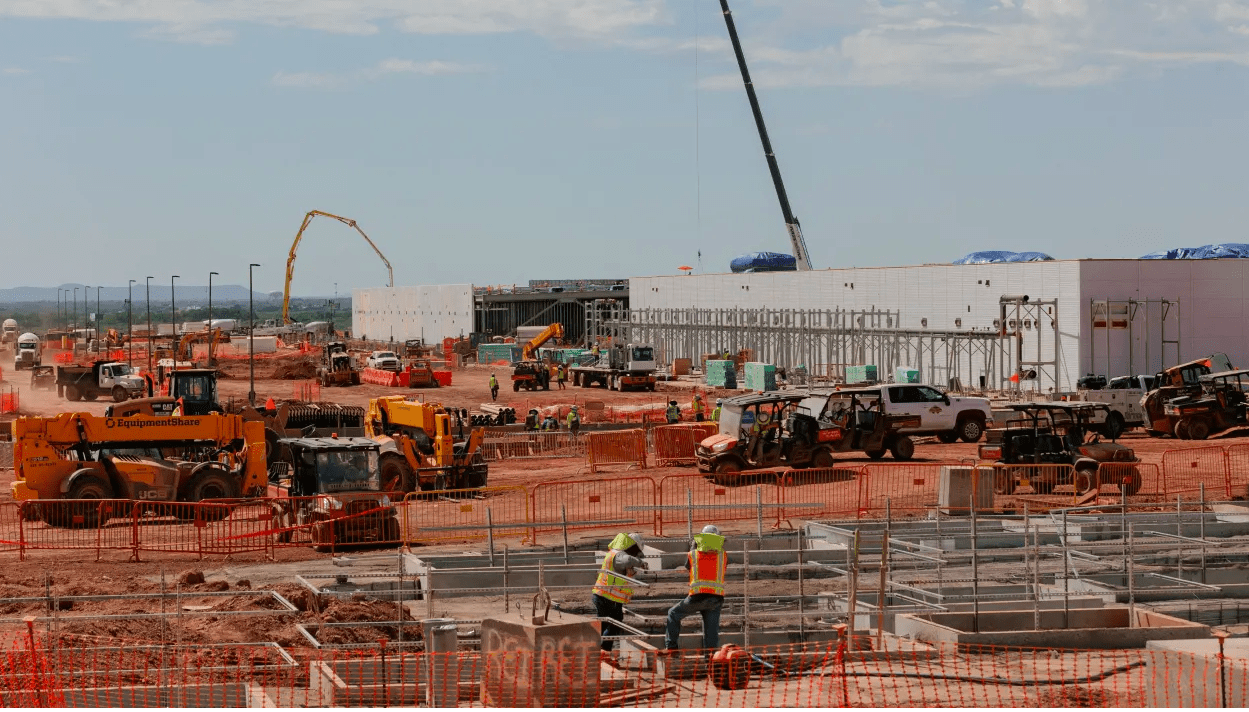

Ammesso e non concesso che questi siano problemi, nell’elenco di problemi causati dall’IA starebbero parecchio in fondo: combustibili fossili e persino centrali nucleari ad hoc per produrre l’abnorme energia necessaria; guerre e stupri dei territori per accaparrarsi terre rare e minerali critici; chilometri quadri di suolo consumato da sterminati centri dati; colossali quantità di acqua per prevenire surriscaldamenti; gli ecosistemi dei dintorni devastati, ecc. Per fortuna c’è una risposta, in mezzo mondo proliferano le lotte contro i centri dati – e vincono pure, persino negli USA.

Saragozza, 27 settembre 2025, manifestazione contro molteplici progetti di centri dati in Aragona.

Ad ogni modo, ponderiamo la questione. Io penso che le vere domande siano: cosa cerchiamo nella letteratura? E cosa ci dà? E quanta discrepanza c’è tra quel che cerchiamo e quel che ci dà?

Parliamoci chiaro: esiste da parecchio una produzione – sia romanzesca sia saggistica – che pare scritta da macchine, perché prodotta a nastro da umani ridotti a funzionare come macchine. Gran parte di quel che vediamo nelle vetrine di certe librerie di catena avrebbe potuto scriverlo un’IA, ed è così da molti anni. Per fare qualche nome, «James Patterson» può anche corrispondere a un tizio in carne e ossa, ma in pratica è una macchina. E lu l’è ‘ncora viv, che dire di «Robert Ludlum», che continua a “co-firmare” nuovi titoli benché sia morto nel 2001? Anche la recente elefantiasy di romance e di romantasy fa pensare a creazioni di menti artificiali.

Se alla letteratura chiediamo roba tutta uguale, allora sì, ben presto non serviranno umani per scriverla. Ma a quel punto non serviranno nemmeno editori per pubblicarla: chiunque potrà generarsela da sé. E se a ciò non corrispondesse un immane, inimmaginabile sperpero di risorse verrebbe da dire: che facciano.

C’è poi la questione, anch’essa mal posta, dello «stile». Un approccio sbagliato alla lettura e al rapporto col personaggio-scrittore, unito alla costante pressione di imperativi commerciali, ci ha fatto credere, e pretendere, che un autore o autrice abbia uno stile, uno solo, il suo e di nessun altro. Se compriamo un libro di, poniamo, Zsigmond Hátszeghy – nome che ho inventato pochi secondi fa – ci aspettiamo ogni volta un libro scritto «alla Hátszeghy». Se non è scritto così ci restiamo male: ma come? Ebbene, per quello c’è l’IA: «Scrivimi qualcosa alla Zsigmond Hátszeghy.»****

Chi scrive non ha per forza sempre lo stesso stile, se per stile si intende la “voce”, il fraseggio, il ricorso frequente a certe tecniche e figure retoriche. A meno che i singoli libri non siano episodi di un unico grande libro o avventure di un unico personaggio, chessò, Montalbano, Henry Chinasky… Ma fuori da questa serialità, ogni libro richiede una propria voce, un proprio stile. Lo disse molto bene Gabriel Garcia Marquez:

«Non si sceglie lo stile. Si può indagare e cercare di scoprire qual è il miglior stile per un tema. Ma lo stile è determinato dal tema, dall’animo del momento. Se si cerca di utilizzare qualcosa che non è adeguato, semplicemente non funzionerà. Poi i critici costruiscono teorie attorno a questo e vedono cose che io non avevo visto. Io rispondo solamente sul nostro stile di vita, la vita del Caribe.»

L’ultima frase non è solo una battuta: illumina il malinteso. Si confonde lo stile – che può variare a seconda dei progetti e delle esigenze espressive – con il mondo di un’autrice o autore, con la sua Umwelt, cioè, parafrasando il biologo Jacob von Uexküll, «il fondamento biologico che sta nell’esatto epicentro della comunicazione e del significato dell’animale-scrittore» (Uexküll diceva «animale-uomo»). Insomma, l’universo soggettivo di un’autrice o autore, che resta nel suo corpo, permane anche nel variare delle tecniche adottate e non si può desumere da una sola frase imitata da un’IA, come nell’esperimento riportato dal New Yorker.

Se chiedi a un’IA un testo «alla Marquez», dovrebbe risponderti con una domanda: «Quale Marquez?» L’autunno del patriarca, per dire, è scritto in uno stile diversissimo da quello di Cent’anni di solitudine. Nondimeno, l’universo soggettivo è il suo. Quello che, semplificando, ha chiamato «la vita del Caribe». Nota bene: non la biografia individuale, di cui chi legge i romanzi potrebbe anche ignorare i dettagli; no, «il nostro stile di vita», c’è un noi, un essere comune. L’essere comune che Marquez si è portato dentro per tutti i suoi giorni. La sua versione di quell’essere comune.

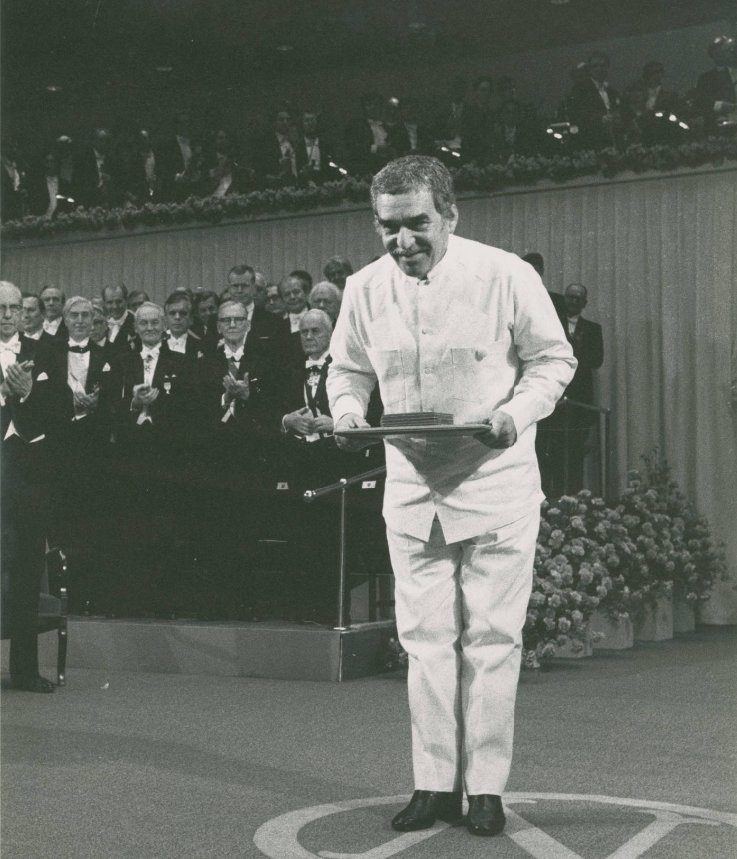

Stoccolma, 8 dicembre 1982. Gabo si presenta alla cerimonia per il Nobel indossando un liqui liqui, abito tradizionale colombiano. Cioè indossando la sua Umwelt di scrittore. Nella sala è il più elegante, e non è un caso.

Questo Gemeinwesen una macchina non può riprodurlo, perché appunto è un fondamento biologico, è esperienza vissuta, mentre la macchina – è bene non scordarlo mai – è non-viva. Tuttalpiù può imitare, produrre simulacri, ma che ce ne frega? Se sono simulacri e imitazioni a interessarci, siamo conciati male. Chiedere al primo pappagallo robot nei paraggi di fare il verso a un autore che abbiamo amato? Se il nostro rapporto con la letteratura è tanto degradato, allora il problema, prima del pappagallo, siamo noi.

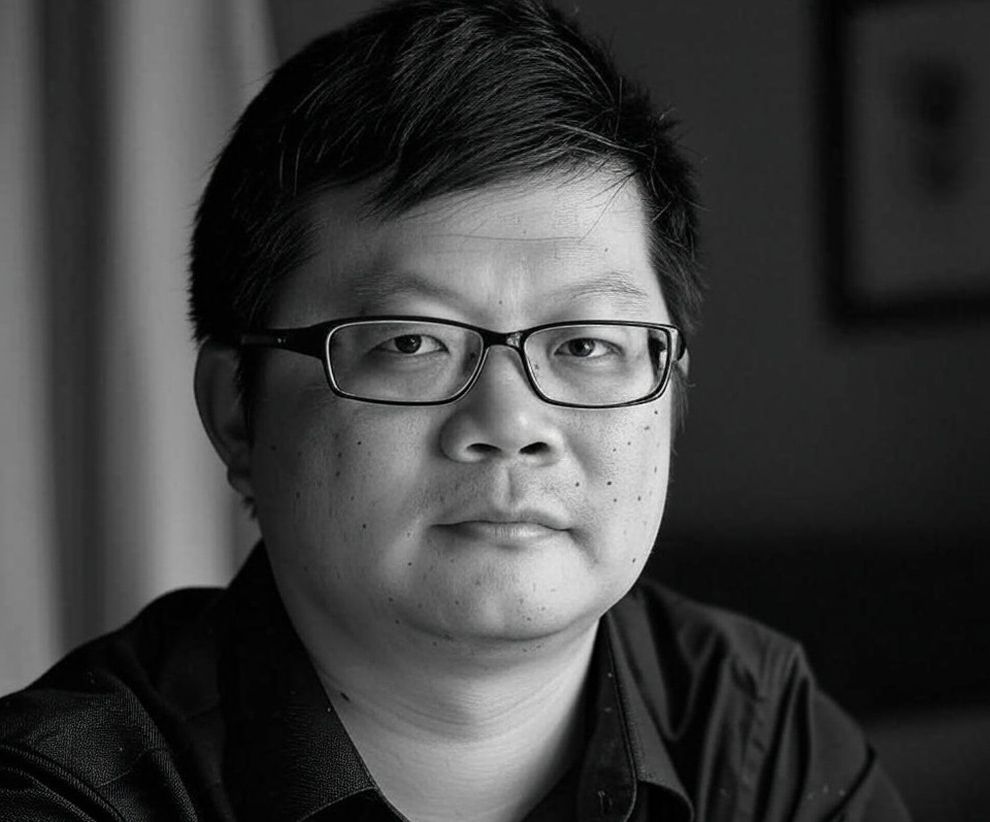

Vale non solo per i romanzi, ma anche per i saggi. Quando nel marzo scorso uscì Ipnocrazia, firmato da un tale Jianwei Xun ma in realtà scritto da un’IA “imbeccata” da Andrea Colamedici, che l’autore cinese non esisteva lo capimmo subito, l’esperimento ci incuriosì poco e – benché molti ci tirassero in ballo, citandoci a sproposito – decidemmo di non scriverne. Come noi capì subito anche Bifo, che invece ne scrisse, e sul suo bollettino Il disertore pose la questione in un modo che trovai impeccabile:

Volto generato da un’IA e attribuito all’inesistente Jianwei Xun.

«Xun descrive la superficie comportamentale della mutazione linguistica e cognitiva, ma non compare mai, neppure una volta, se non vado errato, la parola: “corpo”.

Perché Xun non sa nulla del corpo? Mi sorge quasi il sospetto che non parli mai del corpo perché non ne sa nulla. Probabilmente non ce l’ha. Ma chi è allora Xun se non possiede un corpo? Nel libro non troviamo mai né la parola sensibilità, né la parola dolore […] nel libretto di Xun, mi dispiace doverlo dire, manca il mal di denti. L’automa linguistico sa tutto del mal di denti, intendiamoci, vi può offrire una bibliografia completa sull’argomento, e anche l’indirizzo di un buon dentista vicino a casa vostra. Ma il mal di denti non sa cosa sia, e se per disgrazia vi viene il mal di denti tutta la perfezione ipnocratica di cui parla Xun va a farsi fottere. E il mal di denti non è il peggiore dei mali di cui l’automa sa tutto ma non esperisce niente. Allo stesso modo l’automa non esperisce né la solitudine né la violenza, né la fame né il freddo, né la guerra. Per questo il libro di Xun ci spiega tutto ma non ci serve a niente.»

Si torna dunque all’inizio. Se alla letteratura chiediamo evidenze di umanità, cioè tracce del fatto che è scritta col corpo, con l’interazione dei corpi, con le memorie dei corpi; se le chiediamo la festa dei neuroni specchio, che si attivano quando vediamo – o, leggendo, immaginiamo – altri umani compiere azioni in cui possiamo immedesimarci; se le chiediamo congiunzioni invece che connessioni*****; se le chiediamo di riempire di ulteriore senso i luoghi, che non sono meri spazi e men che meno spazi virtuali…

Se è ancora questo che chiediamo, è probabile che quella letteratura continuerà a darcela gente che ha un corpo e vive, come noi.

Appendice (27/12/2025)

Sulla frase che ha impressionato il New Yorker

Nelle note qui sopra ho cercato di chiarire alcuni specifici equivoci su letteratura, scrittura e stile su cui secondo me si basano molte reazioni all’articolo del New Yorker «What If Readers Like A.I.-Generated Fiction». Equivoci che in realtà sono già nell’articolo, e nell’esperimento di cui racconta e su cui ricama. A monte c’è una grande confusione su cosa sia e cosa faccia la letteratura e addirittura su cosa voglia dire scrivere; da qui discende l’assurdità concettuale e metodologica dell’esperimento, i cui esiti aggravano la confusione iniziale.

Andiamo al nocciolo. Un ricercatore fa “mangiare” a un LLM diversi brani di opere di Han Kang. In traduzione inglese, mentre l’autrice pensa e scrive in coreano. Questo comporta già una perdita di connotazioni, da autore tradotto in varie lingue lo so fin troppo bene; eppure da questi brani – non opere: brani – tradotti l’IA dovrebbe desumere e acquisire lo «stile» di Han Kang, con tutti i malintesi su cosa sia lo stile, di cui ho già scritto. Dopodiché, il ricercatore descrive all’IA una scena del romanzo Il libro bianco, che non è tra i brani già sottoposti, e le chiede di buttarla giù nello stile dell’autrice.

Andiamo al nocciolo. Un ricercatore fa “mangiare” a un LLM diversi brani di opere di Han Kang. In traduzione inglese, mentre l’autrice pensa e scrive in coreano. Questo comporta già una perdita di connotazioni, da autore tradotto in varie lingue lo so fin troppo bene; eppure da questi brani – non opere: brani – tradotti l’IA dovrebbe desumere e acquisire lo «stile» di Han Kang, con tutti i malintesi su cosa sia lo stile, di cui ho già scritto. Dopodiché, il ricercatore descrive all’IA una scena del romanzo Il libro bianco, che non è tra i brani già sottoposti, e le chiede di buttarla giù nello stile dell’autrice.

In questa situazione, una madre veglia il proprio neonato, che ha dato alla luce solo due ore prima. Il bimbo sta morendo, lei lo implora di vivere, ma lui morirà. Se fosse vissuto, sarebbe stato il fratello maggiore della narratrice. Che dunque ci sta raccontando di sua madre. Siamo in un luogo intimo, il più intimo possibile, e pericoloso per chiunque scriva.

Nel romanzo (in inglese), la frase è: «For God’s sake don’t die, she muttered in a thin voice, over and over like a mantra.» [traduzione mia: Per l’amor di Dio, non morire, mormorava con voce flebile, ripetendolo come un mantra»

A tutta prima è una frase banale e contiene un cliché ormai logoro, «come un mantra», ma – ecco uno degli equivoci che più fanno arrabbiare noi scrittori e scrittrici – non si può giudicare un’opera da una sola frase, va valutato l’effetto che essa ha in quel particolare punto del testo, arrivando dopo tutte le frasi precedenti e caricandosi di ulteriore senso grazie a quelle che seguono.

Ad ogni modo, ecco la frase alternativa generata dall’IA: «She held the baby to her breast and murmured, Live, please live. Go on living and become my son.» [Si teneva il bimbo al seno e mormorava: vivi, ti prego, vivi. Continua a vivere e diventa mio figlio]

E il ricercatore, e dopo di lui i lettori di prova, e poi il New Yorker, e ulteriori lettori di prova, e infine i commentatori reagiscono così: urca! potente! commovente! Se un’IA può scrivere una frase così, per gli scrittori cominciano a essere seri problemi! Presto alle case editrici converrà far scrivere le IA e affinare giusto un poco, cosa che abbatterebbe i costi del dover compensare gli autori. A quel punto il ricercatore ripete l’esperimento con brani di altri autori, ne nasce un paper che esce in preprint, arriva il New Yorker e parte la sarabanda.

Ora, se la frase rivela qualcosa, rivela proprio l’incorporeità e inumanità dell’IA, di cui si dice impropriamente che «genera» – da questo dibattito andrebbero banditi tutti gli antropomorfismi e animismi perché stanno facendo danni spaventosi – ma in realtà non genera. Non avendo un grembo, non ha mai avuto in grembo una creatura vivente che deve nascere, non ha mai dato alla luce altra vita, non ha mai provato un dolore come quello di quella madre, può solo tirare a indovinare nel produrre un’imitazione.

Io credo che, in quelle circostanze, nessuna donna che ha scelto di essere madre direbbe: «Continua a vivere e diventa mio figlio», per la semplice ragione che è già suo figlio, lo è nel dato di fatto (è nato da lei), e lo è nell’amore che lei prova per lui da quand’era ancora in grembo. Non c’è madre che non pensi alla creatura che ha nel ventre come già suo figlio o figlia. Vivono in simbiosi, lei sente la creatura muoversi, scalciare, capisce se sta bene o soffre, sono tutt’uno, sono già madre e figlio.

Se un’imitazione così gelida, che andrebbe considerata un vero e proprio lapsus dell’IA, impressiona lettrici e lettori umani – anche del settore, anche scrittori! – perché come frase «funziona» «letterariamente», ribadisco che il problema pre-esiste all’IA, e concerne quel che chiediamo alla letteratura.

Letteratura che non vuol dire una frase, non vuol dire nemmeno un testo, non si riduce all’esito rappresentato dal testo, ma è un processo, un divenire continuo, è un multiverso di opere – e un’opera non è solo un testo – e di mondi e di incontri che avvengono in quei mondi e tra quei mondi, ha una dimensione sociale, concerne i corpi.

Se temiamo che un’IA presuntamente brava a scrivere testi letterari sostituisca tutto questo, vuol dire che abbiamo una concezione miserrima dello scrivere e del leggere.

Le «esternalità» di questo modello di sviluppo dell’IA

Ma ribadisco: in cima alla lista dei problemi causati da questo modello di IA – altri modelli erano stati ipotizzati, e altri sarebbero realizzabili – ce ne sono di ben più concreti, gravi, su scala ben più vasta. Non è possibile tener fuori dal quadro l’ecocidio. L’imprinting ideologico del modello è il solito, quello che chi lotta contro le «grandi opere» ben conosce: X è tecnicamente fattibile? Allora va fatto. Tutte le conseguenze che, se prese in considerazione, metterebbero in questione tale assunto vengono rimosse, diventano «esternalità».

Questo discorso irrita diversi operatori, pensatori e artisti che a livello “posturale” esibiscono pensiero critico, ma scattano in reazione a ogni analisi che reintroduca nel discorso le (false) esternalità.

Non si può criticare solamente l’uso dell’IA a valle, ad esempio il fatto che la grande maggioranza di chi la usa ogni giorno – per fortuna, pare, ancora una minoranza di chi sta in rete – lo faccia per produrre sbobba. Va criticato anche il modello a monte.

Servono a ben poco i brillanti vademecum su usi etici e/o presuntamente liberanti dell’IA se resta sottotematizzato il primevo dato di fatto: questo modello è letteralmente tossico dal principio. È espressione dei settori più schifosi di Big Tech, di un pugno di multinazionali rapaci spesso guidate da miliardari sociopatici e con seri problemi cognitivi (cfr. George Monbiot, Billionaire Brain); è compromesso alla radice con interessi militari e genocidi; è basato su lavoro sottopagato, alienato, invisibilizzato; è vorace di suolo, energivoro, assetato, inquinante e climalterante, arrogantemente lanciato nella direzione opposta a quella in cui dovremmo muoverci come civiltà.

Dai discorsi che danno l’IA per scontata restano sempre fuori i mastodontici centri dati.

I movimenti che lottano contro la loro costruzione sono molto più avanti nella consapevolezza di qualunque teorico che si interroga su come usare un chatbot.

Appendice 2: un ripescaggio audio

Molti anni fa, nel gennaio 2009, tenni una lezione a un master dell’Università di San Marino sull’importanza del muovere il corpo, e l’importanza della fatica, nel lavoro di Wu Ming e in generale di chi scrive, partendo dal suono stesso del verbo scrivere. Mi è tornata in mente in questi giorni, ne ho recuperato un estratto e lo propongo qui. Buon ascolto.

Il fonema K nella parola «scrivere»

Il fonema K nella parola «scrivere»

Durata: 18:27

Estratto della lezione tenuta al master biennale in Comunicazione e nuovi media, Università di San Marino, 17 gennaio 2009.

Note

* Il fatto che la rivoluzione debba essere biologica non implicava, in Cesarano, un rigetto di quella che altri hanno chiamato «la Tecnica». Ecco cosa scrive in questo stesso libro, che è di oltre cinquant’anni fa:

* Il fatto che la rivoluzione debba essere biologica non implicava, in Cesarano, un rigetto di quella che altri hanno chiamato «la Tecnica». Ecco cosa scrive in questo stesso libro, che è di oltre cinquant’anni fa:

«L’uomo ha sempre creduto di trasformare la natura, adeguandola ai suoi fini. Le ha imposto effettivamente violenze profonde, ma non ne ha potuto trasformare le leggi di equilibrio dinamico, che ora trova innanzi a sé come l’imperativo insuperabile, al quale è obbligato o ad adeguarsi o a morire. Ciò che spetta all’uomo, è la conquista di sé nella natura, della sua collocazione coerente nel processo naturale. Scienze e tecnologie, questi miti operanti dell’esserci, queste mediazioni tra il farsi della specie e la resistenza opposta dalla materia, se fin qui hanno rappresentato soltanto, e con una miseria di cui stiamo tirando le somme desolanti, un’intelligenza del mondo di là da venire, e fabbricato un “mondo” illusorio di contingenza e di copertura, mentre di fronte al fallimento planetario devono estinguersi come tali – come scienze e tecnologie del fittizio e dell’illusorio – di sé lasceranno all’uomo realizzato quel poco fondamento efficiente sul quale hanno fin qui sorretto la loro relativa efficacia prammatica. L’uomo signore di sé e senza schiavi non sarà né “selvaggio” né “animale”: ma cesserà definitivamente di esserlo realmente. Cibernetica e automazione, sottratte al dominio del fittizio (e del profitto, che ne e il risultato storico più concretemente astraente) appaiono già fin d’ora come un ponte non troppo fragile gettato tra la fine delle false scienze e l’inizio della vera gnosi.»

** Un esempio di rimozione è nell’argomento che così riassumo: «ci preoccupavamo anche dei videoregistratori, e prima ancora della tv stessa, e se andiamo ancora più indietro c’è sempre stato un panico ideologico legato all’affermarsi di un nuovo medium e in generale di una nuova tecnologia, poi sono entrati nelle nostre abitudini e oggi certe argomentazioni ci sembrano ridicole e infondate».

Il punto è che alcune lo erano, altre no.

La fallacia, qui, consiste nel dare per inteso, addirittura per assiomatico, che tutti i timori mediatici del passato fossero sbagliati. È un bias cognitivo: se qualcosa si è affermato cambiando le nostre abitudini… allora era buono. Le nostre abitudini sono buone, o comunque innocue. Va tutto ben, madama la marchesa. È la solita apologia dell’esistente, basata sulla rimozione di ogni «costo esterno» – ambientale e sociale – dello sviluppo capitalistico, sull’indifferenza a tutto ciò che certe vittorie e abitudini costano e costeranno al mondo.

In filosofia sarebbe hegelismo d’accatto: tutto ciò che oggi è reale è razionale, e se è razionale va accettato.

In psicologia è il «pregiudizio di sopravvivenza»: pensare che le informazioni rimaste disponibili dopo un processo di selezione – anche violenta, anzi, il più delle volte violenta – siano più valide di quelle non più disponibili. Chi denunciava, nella sempre maggiore personalizzazione dell’offerta mediatica, il pericolo del cocooning, dell’imbozzolarsi domestico, dell’isolamento, ha chiaramente, platealmente perso, e sulle macerie delle argomentazioni che portava si è sparso il sale.

Eppure da sotto quel sale qualcosa torna a crescere: la consapevolezza che «you can’t post your way out of fascism».

*** Per un’introduzione al pensiero di Camatte consiglio: Michele Garau, Lo scisma da un mondo che muore. Jacques Camatte e la rivoluzione (Machina Libro, Derive Approdi, Bologna 2024).

Dentro il Luther Blissett Project si leggevano autori come questi: Cesarano, Camatte, l’Amadeo Bordiga degli scritti su terra e ambiente… Non ricordo, almeno nella colonna bolognese, alcuna facile apologia della tecnologia, dello sviluppo, della velocità dei flussi. Piuttosto, ricordo il contrario, ed è uno dei motivi per cui non ci “guantavamo” bene con Decoder, rivista che trovavamo tout court tecnofila e perciò ingenua. In un comunicato blissettiano del 1996, ad esempio, si legge:

«Nel cyberspazio tutto è troppo visibile e (pre)vedibile: ci sono troppi Lumi! Luther Blissett usa [Internet], ma ha anche bisogno di coni d’ombra, di strade lunghe e accidentate, di dicerie che cuociano la cultura di massa a fuoco lento. Quindi non aspettatevi da Luther le solite banalità hi-tech […] e poi, Luther non intende assolutamente “abbandonare il corpo”».

Poiché il LBP non era Uno ma molteplice, tra coloro che adottavano il nome ci sarà stato anche chi, durante o dopo, avrà manifestato altro tipo di smanie, ceduto a tutt’altre retoriche, ma la ricostruzione dell’americano Edmund Berger (Accelerazione. Correnti utopiche da Dada alla CCRU, Nero, Roma 2021), secondo cui il LBP rientrerebbe nella genealogia del cosiddetto «accelerazionismo», è da ritenersi erronea, basata sulla sovrainterpretazione di informazioni parziali, spesso indirette.

**** A scopo di ricerca l’ho chiesto a Chat-GPT e mi ha risposto: «Certo! Di seguito trovi un breve racconto ispirato allo stile di Zsigmund Hátszeghy». Era una roba di cui riporto solo l’incipit:

«Nel villaggio di Kisfalud, nascosto tra le colline verdi e il mormorio del ruscello vicino, viveva un uomo di nome András. La sua casa era isolata dagli altri, circondata da boschi che sembravano sussurrare storie dimenticate ad ogni alito di vento.»

E chissà, forse aver prodotto ‘sto capolavoro è l’equivalente di aver bruciato cento metri quadri di bosco. Mi viene da vomitare.

***** Per questa fondamentale distinzione rimando di nuovo a Bifo, che nella declaratio terminorum del suo libro più importante (E: la congiunzione, Nero, Roma 2021) scrive:

***** Per questa fondamentale distinzione rimando di nuovo a Bifo, che nella declaratio terminorum del suo libro più importante (E: la congiunzione, Nero, Roma 2021) scrive:

«Chiamo congiunzione una concatenazione di corpi e di macchine che può generare significato senza riconoscere e ripetere un disegno preordinato, senza rispettare una sintassi.

La connessione, invece, è concatenazione di corpi e di macchine che può generare significato soltanto seguendo un disegno intrinseco, e conformandosi a regole precise di comportamento e di funzionamento.

La connessione non è singolare, intenzionale o vibrazionale. Piuttosto è concatenazione operativa tra agenti di significato preventivamente formattati: menti e macchine che siano stati preventivamente sottoposti a un lavoro di uniformazione, ovvero che siano stai formattati secondo un codice.

La connessione genera messaggi il cui significato può essere decifrato soltanto da un agente (una mente corporea o una macchina) che condivida lo stesso codice sintattico che ha generato il messaggio.

Nella sfera della congiunzione l’agente di significato è un organismo in vibrazione […] La produzione di significato è l’effetto di singolarizzazione di una serie di segni: tracce, memorie, immagini o parole.

La congiunzione è la sintonia temporanea e precaria di organismi vibratori che scambiano significato. Lo scambio di significato si fonda sulla simpatia, sulla condivisione di pathos.

La congiunzione perciò può essere intesa come divenire altro. Le singolarità cambiano quando si congiungono, come l’amore cambia l’amante, o come la composizione congiuntiva di segni a-significanti provoca l’emergenza di un significato che precedentemente non esisteva.

Al contrario, nel modo connettivo della concatenazione ogni elemento rimane distinto e interagisce solo in maniera funzionale. Piuttosto che una fusione di segmenti, la connessione comporta un semplice effetto di funzionalità macchinica.

Perché la connessione si renda possibile i segmenti devono essere linguisticamente compatibili: la connessione presuppone quindi un processo attraverso il quale gli elementi che devono connettersi siano previamente resi compatibili […]

La congiunzione si può definire come l’incontro e la fusione di corpi rotondi e irregolari che continuamente cercano la loro strada senza precisione, senza ripetizione, senza perfezione.

La connessione come l’interazione puntuale e ripetibile di funzioni algoritmiche, di linee rette e di punti che si sovrappongono perfettamente e che si inseriscono o si disinseriscono secondo modalità discrete di interazione che rendono le parti differenti compatibili con uno standard prestabilito.»

N.B. I commenti verranno aperti dopo le feste. Le feste ci vogliono.

Scarica questo articolo in formato ebook (ePub o Kindle)

Scarica questo articolo in formato ebook (ePub o Kindle)

Ciao a tutte, cerco di aggiungere delle considerazioni a questo articolo “urgente e necessario”.

Da un punto di vista tecnologico, le AI generative(LLM) si trovano su un plateau. Per dirla meglio, il principio, o l’insieme di principi, su cui questi cosi si basano è stato già espresso molto oltre il suo limite. A meno che la scala dei sottostanti hardware che sorreggono la classe flagship di questi LLM non si riuscirà a moltiplicare per un fattore enorme – non si sa come, dal momento che, come ha ben scritto WM1, ormai il ChatGPT di turno consuma energia ai ritmi di un piccolo stato – il rendimento di questi chattini rimarrà su per giù quello che conosciamo ora.

Una piccola dimostrazione empirica, per chi ha seguito le varie evoluzioni, è l’addolcirsi della curva dei miglioramenti di GPT: il vero scossone lo ha dato la versione 4, lì effettivamente si è trattato di un salto notevole, ma da allora in poi i miglioramenti fattuali sono stati poco consistenti, ultra-costosi e sempre raggiunti in maniera molto faticosa. Si ricordi, a riguardo, come OpenAI a un certo punto è stata costretta a rimangiarsi il lancio di una delle sue nuove release perché funzionava peggio della precedente.

Come l’articolo che ha ispirato WM1 per questo post, il 99% della letteratura che tratta di questa roba, tuttavia, vaticina che siamo ad un passo dal fare quello, dal realizzare questo, che si tratti di guai orribili o di traguardi meravigliosi, poi, dipende dal taglio dell’articolo. Questo io lo chiamo “il frame escatologico”. Uno dei gran maestri di questo filone, ormai totalizzante, è stato Yuval Harari, il quale alle porte della primavera 2023 – col suo solito tempismo, cioè durante la prima esplosione di ChatGPT – vergava il famoso articolo uscito sul NY Times dall’idiotico titolo “You Can Have the Blue Pill or the Red Pill, and We’re Out of Blue Pills”. La chiosa è paradigmatica di tutto il filone, ci infila in tutta fretta dentro a un frame ben preciso:

“We have summoned an alien intelligence. We don’t know much about it, except that it is extremely powerful and offers us bedazzling gifts but could also hack the foundations of our civilization”

[continua sotto]

[continuazione]

In altre parole, non ci capiamo in fondo un cazzo, però siamo all’alba di una nuova era che “po’ esse fero o po’ esse piuma”. Il gioco funziona più o meno così: non si capisce bene cosa abbiamo per le mani, anzi evitiamo tout-court di entrare nel merito ora, ma siamo sicuri(loro) che nel vicinissimo futuro crescerà fino a diventare qualcosa di incommensurabile.

Da “pilastri” come quello del volpone Harari, hanno preso le mosse altri milioni di articoli, saggi e paper. Si tratta senza dubbio di un filone che paga, va per la maggiore, perciò chi scrive, mediamente, ci si butta a capofitto. Non c’è niente da fare, all’umano piace speculare su queste stronzate, lo facciamo da cent’anni ormai.

L’industria e tutto il capitale con interessi in quest’area foraggia ampiamente e fomenta in vari modi la grancassa, secondo me, per tre motivi principali:

1) Pubblicità. Che gonfia a dismisura valori di scambio corrispondenti a valori d’uso tutti da verificare (si sente già odore forte di bolla finanziaria)

2) Distrazione. Si cerca, facendo dumping di cazzate e riflessioni oziose, di tenere lontani i problemi veri, come le esternalità che citava WM1 che sono qui con noi da un po’ e si toccano con mano (a parte questa ondata di eccitazione intorno agli LLM, ricordo che esistono tecnologie di AI – vedi computer vision – ben collaudate e messe già ampiamente a valore e che pongono da sempre non pochi interrogativi inquietanti sull’uso che se ne fa nel silenzio generale, oltre a presentare il conto delle stesse esternalità di cui sopra)

3) Strumentalità ideologica. L’ennesima scusa per infantilizzare il lavoratore, aumentare la sua angoscia e, ca va sans dire, aprire ulteriori spazi per sotto-pagare il lavoro. Ho tagliato con l’accetta, ma ci siamo capiti.

Avrei molte altre cose da dire, ma mi fermo qui e vi ringrazio per lo spazio.

Buon anno.

Grazie Fabio, anche per aver ribadito che il focus del testo qui sopra è la critica a – mi tocca ricitarmi – «una sfilza di premesse sbagliate, false questioni e fallacie logiche» alimentate dal pezzo del New Yorker. Il bersaglio polemico è quello. Non solo: il post argomenta che si tratta di falsi problemi, o al massimo di problemi di minor conto, a fronte di quelli più seri che stanno a monte ma vengono pre-rimossi dal dibattito, o fintamente riconosciuti con una concessione en passant per poterli ignorare meglio.

C’è chi si è fatto sfuggire questa premessa, che pure è esplicita, e in pratica ha commentato un altro testo che non esiste. Perché accade?

Perché invece che leggere si percorre il testo di gran furia scalpitando per dire subito la propria sui social; peggio ancora, si commenta avendo letto solo screenshot di frasi strappate al contesto e gettate al pubblico ludibrio (metodo che contro di noi fu “weaponizzato” nel 2020-2021, da allora neghiamo a chi vi ricorre qualsivoglia dignità di interlocutore); addirittura, si commenta fidandosi di brandelli di resoconti di seconda mano.

Il risultato è che leggendo quegli scambi non si capisce assolutamente niente di quel che io sto dicendo. Nelle settimane scorse si è visto bene. Si potrebbe compilare un elenco ragionato delle critiche totalmente fuori fuoco – spesso vere e proprie allucinazioni, come quelle di certi chatbot – scribacchiate sui social.

WM teme di essere sostituito da un’IA.

Qui sopra si afferma e argomenta l’opposto, definendo questa una falsa aspettativa generata da articoli come quello preso in esame.

WM si attarda su una posizione «umanista».

Al contrario. La premessa, non da oggi, è anti-antropocentrica, il punto di vista è ecologico ed ecosistemico («ecocentrico», scrivevamo nello sfortunato memorandum sul NIE), il referente è il vivente tutto e la prospettiva è quella del riconoscimento di un essere comune il più ampio possibile.

WM ripropone il mito dell’Autore.

Mito che mettiamo in discussione da decenni nella teoria e nella prassi, e che anche nel testo qui sopra viene subito ed esplicitamente accantonato.

Toh, WM “all’improvviso” diventa “antitecnologia”!

Quanto scritto nelle note qui sopra è in piena continuità con decenni di critica al feticismo tecnologico che maschera rapporti di produzione, di proprietà e di potere. E per quanto riguarda il sottoscritto, è una linea portata avanti fin dai miei scritti più acerbi. Il più antico rintracciabile è sul n.21 della rivista “La contraddizione”, novembre 1990. Abbiamo scritto di feticismo della merce digitale, di capitalismo dei Big Data, di cattura e colonizzazione algoritmica della comunicazione umana e della vita ecc. E l’aspetto ecologico di queste critiche è da molti anni al centro delle nostre preoccupazioni.

WM1 dopo anni di scrittura “collettiva e incorporea” scopre il “mal di denti”.

A parte che il mal di denti è una citazione da Bifo, forse è proprio chi crede che “collettiva” implichi “incorporea” a dare per implicite logore mitologie sul singolo autore. La nostra scrittura collettiva è una faccenda molto fisica, artigianale e conviviale. Non solo senza vederci di persona il più spesso possibile non saremmo riusciti a scrivere nessun romanzo collettivo, ma da sempre spieghiamo che al nostro non apparire nei media corrisponde un grande investimento di tempo ed energie nel curare relazioni in carne e ossa.

Proprio WM parla, che viene da Luther Blissett, un’esperienza disincarnata.

Ehm, può definirla “disincarnata” solo chi non ha la minima idea di cosa fosse. Derive urbane e altre esplorazioni psicogeografiche; performance e teatro di strada; feste mobili su mezzi pubblici; allestimenti di riti pseudo-druidici; darsi appuntamento in un dato luogo per fare un “attacco psichico”; infangarsi nei boschi per allestire il set di una beffa satanica; continue riunioni “in presenza” (espressione che all’epoca sarebbe stata tautologica)… Tutto questo è documentato e facilmente reperibile. Anche qui, si confonde il non apparire nei media con l’essere “disincarnati”, quando invece è la precondizione per essere più liberamente corporei.

WM ha una concezione “abilista” della scrittura, dire che si scrive coi corpi è discriminatorio, che dire allora della scrittura di uno come Stephen Hawking?

Hawking scriveva grazie a un software che traduceva in testo i movimenti oculari e lievi movimenti delle guance. Gli occhi e le guance sono corpo, e io non riesco a immaginare una scrittura più caparbiamente fisica di questa.

Perché mai dire “corpi” dovrebbe implicare corpi “in forma”, corpi “atletici”, corpi “a norma”? Il senso è proprio l’opposto, nel testo qui sopra parlo di «fragilità» dei corpi come limite all’espansione del non-vivente capitalistico, e non è certo un’affermazione nuova o repentina, è un chiodo su cui battiamo da anni.

Aggiungo che ho più volte omaggiato lo scrittore argentino Ricardo Piglia, perché da un suo racconto ho tratto l’ispirazione per il personaggio di Ilario Nevi. Fa parte della raccolta I casi del commissario Croce, che Piglia, ormai quasi completamente paralizzato, scrisse alla maniera di Hawking. Finché avrò un po’ di corpo, lo userò per scrivere.

Noi siamo i nostri corpi, qualunque forma e qualunque fragilità abbiano. Io mi chiedo: in nome di cosa si critica una banalità di base come questa? In nome di un dualismo mente-corpo screditato e superato in tutti gli ambiti scientifici? La mente è il corpo, e viceversa. Oppure di un dualismo anima-corpo?

WM cita i «neuroni specchio» dunque a) usa la scienza in modo abusivo; 2) ha una concezione solo mimetica dell’arte.

A parte che i neuroni specchio sono usati in modo letterario in quanto citati dentro una metafora («la festa dei neuroni specchio»), e che tale metafora è focalizzata non tanto sulla mimesi in senso aristoteliano quanto sull’empatia tra le persone… A parte ciò, quel brevissimo passaggio sta dentro un elenco di molteplici cose che noi chiediamo alla letteratura, leggendo il quale davvero non si capisce dove stia questa supposta reductio ad mimesim. Lo ripropongo qui:

«Se alla letteratura chiediamo evidenze di umanità, cioè tracce del fatto che è scritta col corpo, con l’interazione dei corpi, con le memorie dei corpi; se le chiediamo la festa dei neuroni specchio, che si attivano quando vediamo – o, leggendo, immaginiamo – altri umani compiere azioni in cui possiamo immedesimarci; se le chiediamo congiunzioni invece che connessioni; se le chiediamo di riempire di ulteriore senso i luoghi, che non sono meri spazi e men che meno spazi virtuali…»

Mi fermo qui. È solo un campionario messo insieme su due piedi, non esaustivo, delle pseudo-obiezioni da social.

Abbandonando un po’ il rapporto fra letteratura e IA, vorrei sottolineare che, come questa (cosiddetta) IA non può capire il rapporto fra madre e figlio/feto perché manca dell’esperienza, molte persone non riescono a capire bene cosa sia un’IA, cioè una banale macchina.

Già c’è questo nome “Intelligenza Artificiale”, che l’esperienza umana fa immaginare che sia simile a un cervello, con un processo allucinatorio difficilmente eludibile.

Esempio:

Se chiedi a ChatGPT “Che ora è?” (almeno finora) puoi ottenere qualsiasi risposta fra 00:00 e 23:59, assolutamente a cazzo.

Perché? Perché per dare una risposta l’IA guarda nel suo “bagaglio culturale”, nel suo archivio e trova milioni di testi in cui è scritto un qualche orario e usa come base uno di questi.

Se vuoi ottenere l’ora reale devi chiedere “Dimmi l’ora attuale, controllando in rete”, allora esce dalla sua scatola e “capisce” quale sito consultare per ottenere l’ora.

L’esempio fa capire come l’IA non possa agire come il cervello di un umano, capace di correlare esperienze non specificate.

Un umano infatti è conscio del fatto che l’ora è qualcosa che cambia continuamente, non è qualcosa di già archiviato.

ChatGPT può comporre testi e poesie che hanno senso. Per utilizzare un linguaggio non serve vedere la realtà esterna.

Basta “imparare” come le parole s’incastrano tra loro. Un “modello” addestrato, ha divorato frasi, articoli, dialoghi, libri. Ha una mappa su quali parole seguono altre parole, quali costruzioni sintattiche funzionano, quali argomenti sono collegati.

Semplicemente predice quale parola ha più probabilità di seguire la precedente. Non “sa” ciò che scrive, ma applica solo dei pattern statistico-predittori.

Gli LLM non ragionano, ma semplicemente riproducono strutture che funzionano.

ChatGPT ti dice un’ora “sperando” che tu non controlli.

Per scrivere copioni di serie Tv una uguale all’altra l’IA diventerà un ottimo strumento, replicare è la sua forza, ma scrivere un nuovo copione capace di stupirci non lo può fare (almeno allo stato attuale).

Ben vengano quindi articoli e discussioni che analizzano l’utilizzo della macchina IA per quello che serve. Perché è una macchina e come macchina dobbiamo trattarla.

È adatta sui terreni accidentati? Sulla neve? Per estrarre acqua della conoscenze dai pozzi della memoria?

Curiosamente ricordo di, una volta, aver parlato con un amico riguardo ad IA e letteratura, discussione in cui arrivammo all’esatto opposto delle argomentazioni proposte in questo articolo. Anziché soffermarci su cosa gli umani sapessero che l’IA non sapesse, pensammo che forse la ragione per cui leggiamo sia per vedere una prospettiva ridotta della realtà. Ridotta all’esperienza di qualcuno che ha vissuto in un solo paese in tutta la sua vita, o all’esperienza di qualcuno che ha viaggiato tutta la sua vita (perché allora non può aver vissuto tutta la sua vita in un solo paese), o all’esperienza di qualcuno che un po’ è rimasto ed un po’ ha viaggiato (perché allora non può aver fatto né l’una né l’altra delle due altre cose). In un certo senso si para dalla stessa parte, cioè che all’IA manca qualcosa di fondamentale, solo che per noi non le mancava qualcosa di positivo ma qualcosa di negativo, le *mancava la mancanza* che può mancare solo all’essere umano. Le argomentazioni empiriche presentate nell’articolo sembrano dare ragione a voi (in particolare l’esempio della madre in Han Kang, che per l’IA sarebbe in grado di costruire una frase tutta d’un fiato poco dopo aver partorito), però il futuro non è mai noto, quindi credo che nel cassetto della mente conserverò sempre quest’idea che ciò che rende l’intelligenza umana umana sia la sua incompletezza.

Non c’è rigida polarità positivo/negativo se parliamo dell’esperienza umana, è vero che funzioniamo anche noi “elettricamente” ma non siamo batterie :-) Stiamo dicendo la stessa cosa, l’IA può avere malfunzionamenti, subire avarie, ma non prova dolore, né fisico perché non ha un corpo né psicologico perché non ha una psiche (che pure quella è incorporata), dunque non può prefigurarsi in una condizione di lutto per la morte di una persona amata, addirittura di un figlio che hai appena avuto. Può giusto simulare in base a probabilità statistiche desunte dal già-espresso la superficie comportamentale dell’espressione umana in circostanze simili.

Sempre sulla sostanza concreta delle catene di parole che ‘sti cosi producono, ricordo che il dibattito speculativo sui limiti della macchina ha avuto varie ondate ed ha coinvolto svariate discipline per la buona parte del secolo scorso. (quello a differenza del marasma di oggi, era dichiaratemente e convintamente speculativo)

Le domande sui limiti della macchina, e se la macchina potrà mai eguagliare/rimpiazzare l’uomo, sono domande che non hanno stimolato solo la letteratura di fantascienza d’antan – quella che ci ha regalato picchi tra i più alti raggiunti dal genere. Già all’indomani della pubblicazione del test di Turing, infatti, si scatenò un concitato filosofeggiare al quale si divertirono a prendere parte menti molto lucide dell’epoca. Sarebbe impossibile qui illustrare i vari rivoli di quelle discussioni, in ogni caso voglio lasciarvi una splendida citazione del neurologo Geoffrey Jefferson che riassume la sua posizione così:

“Not until a machine could write a sonnet or compose a concerto because of thoughts and emotions felt, and not by the chance fall of symbols, could we agree that machine equals brain — that is, not only write it but know that it had written it.”

Ma è molti anni più tardi che, secondo me, si è riusciti a cogliere il bersaglio al centro del movimento di tutte le critiche sui limiti del ragionamento sintetico, tra l’altro nell’ambito di una disciplina non tra le più considerate: le scienze cognitive. Dobbiamo a Steven Harnad, scienziato cognitivo, la prima formulazione del Symbol Grounding Problem, nel paper dallo stesso nome. In estrema sintesi, sostiene che finché la macchina possederà nient’altro che simboli, cioè rappresentazioni, solo con quelli e su quelli potrà operare e non sugli oggetti di cui i simboli costituiscono la rappresentazione.

Dall’abstract:

“How can the semantic interpretation of a formal symbol system be made intrinsic to the system*, rather than just parasitic on the meanings in our heads? How can the meanings of the meaningless symbol tokens, manipulated solely on the basis of their (arbitrary) shapes, be grounded in anything but other meaningless symbols?”

* in realtà il paper, oltre a formulare il problema, cerca di proporre uno schizzo di soluzione

Sì, il nesso è che alla fine sono due modi di porre lo stesso problema. Comunque correggo un disguido: per positivo/negativo non intendevo qualcosa di polare o qualitativo, ma proprio di quantitativo, nel senso di saperne più o meno, e appunto la conclusione a cui ero arrivato allora era quella secondo cui noi umani “ne sappiamo di meno” e quindi elaboriamo la stessa cosa diversamente (in altre parole la particolarità umana rispetto alla sua mera imitazione verrebbe da una differenza qualitativa scaturita da un numero negativo rispetto alla quasi-onniscenza dell’IA). Ovviamente questo film mentale non è nulla rispetto alla disamina posta nell’articolo, ma ho trovato interessante il fatto che fossero così vicine nell’intento eppure così lontane nella teorizzazione.

Ok, chiarissimo. Tenendo comunque conto che in realtà un LLM non “sa” niente.

La febbre da datacenter è partita anche in Italia, sono stati recentemente approvati 14 nuovi progetti, quasi tutti intorno a Milano e uno a Roma. C’è soprattuto Microsoft, ma anche vari operatori europei, un po’ sovranità digitale e un po’ no dunque. Un aspetto importante è connesso allo sbandierato uso delle rinnovabili. Il bando “Energy Release 2.0”, di cui sono stati recentemente emanati i decreti operativi, prevede che l’azienda energivora possa acquistare oggi energia dal mercato, con l’impegno che costruirà impianti rinnovabili entro il 2030 che “rimborseranno” l’energia acquisita nell’arco di 20 anni. In pratica produco CO2 oggi con la promessa che entro il 2050 produrrò energia equivalente da fonti rinnovabili, una logica che passa per riduzione delle emissioni.

Un riassunto dei 14 progetti: https://www.lindipendente.online/2025/11/15/data-center-in-italia-14-progetti-gia-approvati-quali-sono

Un esempio di previsioni di enorme crescita dei consumi misto a greenwashing AI: https://www.repubblica.it/dossier/economia/transizione-sostenibile/2025/09/06/news/l_italia_dei_data_center_da_giganti_energivori_a_motori_della_sostenibilita-424830538

Sempre Repubblica con la bava alla bocca per la “opportunità da 165 miliardi di euro”, con punto orwelliano per cui far esplodere il consumo elettrico dei datacenter al 10% del consumo totale… ridurrebbe la produzione di CO2: https://www.repubblica.it/tecnologia/2025/12/17/news/la_mappa_dei_data_center_italiani_un_opportunita_da_165_miliardi_di_euro_in_dieci_anni-425045584

Giulia Pastorella (deputata di Azione) si lamenta dei ritardi al bomba libera tutti dei permessi: https://www.agendadigitale.eu/infrastrutture/data-center-in-italia-perche-la-legge-non-puo-piu-aspettare

Questo aspetto della questione – che, come scrive WM1, è assolutamente centrale – si lega al problema di come viene prodotta e distribuita l’energia necessaria al funzionamento concreto dell’IA, da chi viene prodotta, dove viene prodotta, secondo quali “rapporti di produzione”, con quale impatto ambientale e sociale, ecc. ecc. Il nesso con l’aggressione di stampo brutalmente coloniale in corso in questi anni soprattutto in Sardegna e, in maniera simile, in qualche area del Mezzogiorno italiano, è evidente. O lo sarebbe, se la faccenda uscisse dal cono d’ombra in cui è relegata.

Per garantire il funzionamento dei mega data center – posti in quelle aree che i vertici di Terna e il governo Meloni hanno definito “le più produttive del Paese” – l’energia necessaria sarà prodotta in quelle che sono considerate – e conseguentemente trattate – come “aree di sacrificio”. Naturalmente la propaganda che sostiene questa gigantesca operazione neo-coloniale ed estrattiva si basa sulla retorica della transizione energetica (o addirittura *ecologica*): greenwashing brutale. Ovviamente di ecologico nell’installazione di decine, centinaia di giganteschi rotori, alti, dal suolo, anche 250 metri, o di distese di accumulatori, in aree di pregio naturalistico o storico-archeologico, ovvero in zone a vocazione agricola, non c’è assolutamente nulla. Basti anche pensare ai costi di trasporto e ai lavori di sbancamento di intere colline e distese boscose necessari solo per far transitare i mezzi (tutta roba documentata e fin troppo visibile). Da notare che in tutto questo non hanno alcun ruolo il consumo energetico locale, le necessità basilari delle popolazioni coinvolte. Finisco sottolineando il dato della produzione energetica in Sardegna, che eccede già oggi del 40% il fabbisogno interno. Insomma, è sacrosanto, quando si parla di IA, considerare anche tutte le premesse materiali, sociali, ecologiche e dunque politiche che la riguardano.

[Sulle questioni letterarie.] WM1 correttamente dice che “starebbero parecchio in fondo”. Eppure le multinazionali dell’AI ci stanno molto attente, perché sono un aspetto della guerra ideologica. Già nel 2019 Microsoft organizzò un panel a un convegno della MLA – associazione Usa di studiosi di lingua e letteratura – per presentare GPT-2 e porre questioni provocatorie su AI e autorialità. Alla pubblicazione del famoso paper dei “pappagalli stocastici”, Google licenziò una delle autrici. Certo perché faceva inaccettabili richieste “decel” di paletti all’implementazione dell’AI, ma cosa gravissima lo faceva sulla base di considerazioni teoriche. La questione di dove sta il significato di un testo ha impatti diretti sullo sviluppo di queste tecnologie e sulla legittimità dei loro prodotti, e big tech coerentemente promuove prospettive teoriche “compatibili”. Nel nostro cortile, si può vedere un esempio misero di questo carico ideologico nella pochezza argomentativa mista a sarcasmo adolescenziale di un pezzo uscito su Indiscreto a titolo “I Don Ferrante della IA”. Più dignitoso un altro “Le AI sognano pappagalli stocastici?”, dove però si finisce per presentare come punto di equilibrio una posizione ultra estremista come quella di Daniel Dennett (che sosteneva che la coscienza è un’illusione. A chi gli chiedeva “illusione di cosa?” rispondeva “di nulla!” e credeva di aver risolto il problema). È importante dunque approfondire anche questi aspetti, per essere in grado di sbrogliare gli interventi interessati dalle genuine complessità teoriche. Ho trovato idee utili nel lavoro di Hannes Bajohr, uno studioso tedesco, su vari corni della questione: quello autoriale con “Writing at a Distance: Notes on Authorship and Artificial Intelligence”, quello semantico con “Dumb Meaning. Machine Learning and Artificial Semantics”, quello delle aspettative dei lettori con “On Artificial and Post-artificial Texts: Machine Learning and the Reader’s Expectations of Literary and Non-literary Writing”. Segnalo anche “Poetry will not optimize” di Michele Elam. Non posso entrare nel dettaglio, mi limito a un invito alla lettura.

Ma perché non dovremmo accettare che l’AI simuli la superficie comportamentale dell’esperienza umana? Se la simula bene, magari meglio di come la descrivono a volte gli umani stessi, perché dovremmo escluderla a priori? A me “diventa mio figlio” non è dispiaciuto, l’ho trovato strano ma mi ha fatto riflettere. La questione ambientale ha senso, ma bisognerebbe fare un paragone con quanto consuma un essere umano e per fare cosa. Non penso che si debbano vedere le produzioni dell’AI come contrapposte a quelle umane. Alla fine è come tutte le tecnologie, utili se usate con buon senso, uno spreco se di risorse se usata stupidamente.

Il punto è che non è vero che “tutte le tecnologie” dipendono da come le usi tu, singolo individuo, se con buonsenso o stupidamente.

Questo può valere giusto per tecnologie molto semplici, utensili basilari, il cui valore d’uso è trasparente (e del valore di scambio quasi ti dimentichi). Un martello, per dire. La sua logica di fondo non è equivocabile, sono pochissimi gli “algoritmi” inscritti in quell’oggetto e l’utilizzatore ce li ha chiari quanto il fabbricante: lo usi per piantare chiodi, lo usi per spaccare la testa a qualcuno, poco altro. Inoltre, dopo che lo hai usato, lo riponi, e se non lo usi per mestiere o per hobby chissà quando ti ricapiterà di usarlo. Non ci sono spinte sociali a usarlo in un modo continuativo che inneschi mutazioni antropologiche. E un martello quante volte lo compri nella vita?

Al di sopra di questo livello basic, le cose cambiano di parecchio: le tecnologie incorporano in modi complessi i rapporti sociali che le producono e i bias ideologici di chi le produce, rispondono a logiche di fondo che sfuggono ai più e soprattutto non si capiscono se partiamo dall’utilizzo individuale, dal “diritto” del singolo di utilizzarle ecc. È il loro uso di massa il punto, sono gli incentivi sociali e commerciali a usarle il problema. Vale tanto per l’automobile (abbiamo visto le conseguenze urbanistiche, sociali e ambientali del bias ideologico a favore del trasporto privato individuale, bias che ha plasmato la tecnologia stessa e vi è inscritto dentro) quanto per la slot machine (un perfetto esempio di tecnologia che si può usare solo male), vale per quei social media che ciascuno si illude di usare “a modo suo” mentre i suoi comportamenti sono pilotati algoritmicamente e gamificati, e le vite di tutti vengono trivellate per estrarne dati (nella massima opacità ovviamente). L’attuale modello di sviluppo delle IA alza drasticamente tutti i cursori di questo mixer, è veramente ingenuo ridurre tutte le contraddizioni in campo al “dipende da come la usi”. E mi sono limitato a tecnologie di uso civile, figuriamoci quelle militari.

Quanto all’impatto ambientale, non scherziamo, sfida l’immaginazione leggere di quanto schizzerà fuori scala il “fabbisogno” di energia, materie prime e acqua, e che impatto avrà la proliferazione di centri dati sui territori se si continua a questo ritmo. Tarare i ragionamenti sull’esperienza dell’utente a valle di tutto il processo è terrificantemente fuorviante, le domande necessarie riguardano ciò che accade prima.

C’è un elemento in più da tener presente: questa è la prima macchina che ti “parla” e ti “capisce” (spesso di più di tanti amici e familiari – almeno ti sembra).

Ci sono sempre stati quelli che la domenica lavano la macchina e l’accarezzano come un’amante, ma l’automobile in se non fa nulla per farsi apprezzare.

L’IA è progettata per accondiscendere e accettare che ti mostri a “lei” senza filtri.

“Gli incentivi sociali e commerciali” di cui parli con l’IA sono poca cosa, qui è la capacità di essere così “servizievole” che induce chiunque la usi a reiterare l’esperienza.

È ormai dimostrato, per esempio, che i chatbot relazionali generino dipendenza e psicosi e amplifichino i deliri di chi è instabile.

Ci sono fior di studi accademici che lo confermano.

Il problema che sollevavo nell’altro mio commento è che molta gente fatica a capire che si tratta di una macchina.

Mentre il trapano, ma anche l’automobile che pur viene carrozzata con un aspetto accattivante, sono macchine per (quasi) tutti.

Questa “macchina” non ha un corpo riconoscibile e tradisce i sensi.

È vero Valerio, noi tendiamo a umanizzare tutto e qualsiasi cosa.

Anche in questo caso, gli intruppi col confessore cibernetico non sono iniziati ieri. Verso la fine degli anni ’60 il MIT realizzò ELIZA, una specie di proto-chatbot che rispondeva alle domande dell’utente facendo frullare algoritmi molto rudimentali. Nonostante la pochezza, molti ne rimasero impressionati, anche per via dello stile delle risposte, della serie “sei sicuro che…? Hai pensato bene a…?”.

David Avidan, addirittura, pensò bene di utilizzare un derivato di questa ELIZA per mettere insieme niente popò di meno che un libro su delle conversazioni intrattenute con la macchina, dall’inquietante titolo “My Electronic Psychiatrist: Eight Authentic Talks with a Computer”.

Tutto si tiene, anche se preferiamo il presentismo, nei ricorsi della storia.

Poi volevo ricollegarmi al discorso sulla neutralità della tecnologia. Al netto dell’uso più o meno fruttuoso che si riesce a fare dei vari chattini, questa ondata di GenAI prosegue su un tracciato assai nefasto rispetto al rapporto tra umano e tecnologia. La silicon valley non riesce a produrre valore d’uso che si venda da solo più o meno dalla commercializzazione del primo s.o. a interfaccia grafica, e perciò ha cambiato sport ormai da anni: si occupa, in effetti, di engagement, e per eccellere in questo sport ha dovuto stravolgere la stessa infrastruttura epistemica dell’umanità –di questo abbiamo parlato in lungo e in largo anche qui su GIAP, ci sono studi stra-noti ormai su come i vari social abbiano letteralmente creato delle patologie.

Come ha notato Valerio, anche i chatcosi proseguono su questa tendenza grazie al combinato disposto dell’enorme hype e allo stile di consumo per il quale sono progettati. Purtroppo, molte persone tenderanno inevitabilmente a usarli come confessori, come risponditori di domande altrimenti inconfessabili e tutta ‘sta monnezza qui.

«È ormai dimostrato, per esempio, che i chatbot relazionali generino dipendenza e psicosi e amplifichino i deliri di chi è instabile.»

Innanzitutto mando un rispettoso e speciale saluto a Valerio Minnella.

Dice bene, il rischio di dissonanza cognitiva tra l’operatore e la macchina è fuori scala nelle interazioni con un chatbot.

La nostra miglior amica non potrebbe proprio competere. Sul campo delle possibili combinazioni di parole che uno qualsiasi di questi virtuosi marchingegni del travestimento linguistico è capace di restituire, soltanto un prolungato abbraccio o una serata di bagordi in buona compagnia potrebbero alleviare il malessere. I corpi inisieme, piu che le parole. Su quel campo possiamo ancora competere e vincere.

Il punto cruciale, secondo me, importantissimo quanto difficile da tener presente, è che questi cosi non ci stanno realmemnte rispondendo.

Piuttosto imitano la voce del personaggio che credono noi vogliamo ascoltare.

Nel tentativo di scoprire i suoi veri scopi e desideri, rischiamo di restare intrappolati nelle nostre stesse narrazioni che si autoalimentano.

Se un amico mi confida di essere stato rapito e vivisezionato da un alieno, o che Wu Ming in realtà è un collettivo di neo-nazi in incognito, ho tutto il diritto/dovere, ad un certo punto, di dargli il palo o consigliargli una qualche terapia. Un chatbot lo tirerà dentro la sua stessa paranoia.

Come gli antichi oracoli, spesso enigmatici e fallibili anche per i loro devoti, i doni e le verità del GLLMM sono quelli di un trickster. Sotto questo aspetto, la situazione sociale/politica attuale a me pare confermare che trattasi di “self-fulfilling prophecy” su larga scala.

Bella discussione. Here’s my 2c.

Invogliato da questo articolo di WM1 ho iniziato a leggere «Nell’occhio dell’algoritmo. Storia e critica dell’intelligenza artificiale» di Matteo Pasquineli. Consigliatissima analisi materialista della situazione.

Sintetizzando che di piu non si potrebbe.

Seguendo Pasquinelli (che parte da una stupenda analisi storiografica dell’algoritmo) il codice che governa l’IA non nasce nel cervello ma nella coreografia sociale del lavoro: nei gesti ripetuti, nelle procedure collettive che il capitale traduce in macchine e archivi di sorveglianza.

L’algoritmo è quindi una mappa del potere travestita da mente, un’astrazione che cattura pratiche vive e le restituisce come efficienza.

Qui secondo me ci torna utile la magia critica dell’amico Mariano Tomatis che io trovo offre un meraviglioso controcanto: come esperti di mentalismo e magia che smontano un effetto speciale per mostrarne i meccanismi, possiamo guardare all’IA come al più sofisticato trucco contemporaneo, meraviglia programmata che nasconde filiere di sfruttamento, gerarchie invisibili e incalcolabili esternalizzazioni ambientali. Basta sforzarsi (e informarsi) un attimo.

Inoltre, come suggerisce Derrida in «La farmacia di Platone», dove sostiene che la scrittura è un pharmakon, insieme rimedio e veleno, anche l’IA è ambivalente: cura l’inefficienza e, al tempo stesso, avvelena la trasparenza delle pratiche sociali, mascherando la dipendenza da infrastrutture materiali e l’estrazione di risorse sotto un’aura di neutralità tecnica.

Non si tratta di demonizzare la tecnica, ma di restituire al segno il suo corpo: riconoscere che ciò che chiamiamo “intelligenza” è automazione della cooperazione umana, e che la meraviglia, quando non ci si lascia catturare dal marketing del digitale, può anche diventare pratica di emancipazione.

Matteo – mi farebbe strano chiamarlo per cognome perché eravamo coinquilini – proviene, come noi, dalla colonna bolognese del Luther Blissett Project, in modi diversi andiamo sviluppando spunti che volavano in tondo dentro quel tornado artistico e culturale.

Del suo approccio defeticizzante e della sua critica materialistica dell’IA apprezzo proprio la ricostruzione genealogica, il rintracciare le origini degli odierni miti sull’IA nella junk-science basata sulla psicometria nel XX secolo e sulla craniometria nel XIX. Psicometria e craniometria che, come giustamente scrive, sono al massimo «discipline» ma non scienze. Fondamentale è stato anche il ricorso alla statistica per produrre rappresentazioni normalizzanti dei comportamenti sociali.

Cruciale, in questo percorso, è stata l’invenzione del «quoziente d’intelligenza», basato su un’idea angusta e mentecatta di intelligenza, parametro di misurazione il cui successo anche pop non ha tanto a che fare con l’esattezza scientifica, quanto con finalità tecnopolitiche: il QI serviva a gestire meglio, e fin dalla scuola, la divisione classista/razzializzata del mercato del lavoro. Ed è in base a quell’idea tutta strumentale di intelligenza che oggi, senza colpo ferire, possiamo chiamare «intelligenza» la capacità di calcolo su cui si basa un LLM.

La psicometria era appena più sottile di sua madre, la craniometria, che era più esplicita nel costruire sulla misurazione – in quel caso non intellettiva ma fisica – una teoria di razzismo scientifico che doveva giustificare le gerarchie sociali e tra popoli.

L’IA si porta dentro tutta questa storia, e si vuole imporla come nuova metrica sociale gerarchizzante. Non a caso le narrazioni propagandistiche descrivono chi “è contro l’IA” come arretrato, incapace di adattarsi, in fondo inferiore, perciò il suo lavoro è meritevole di scomparire, e in definitiva anche il suo modo di vivere.

Naturalmente, e questo Matteo lo spiega molto bene, ci saranno meno «scomparse» di quanto faccia credere questa retorica. Accadrà molto più spesso che, a causa dell’IA, peggiorino le condizioni in cui si svolge qualunque lavoro, perché l’adozione di queste macchine aumenta precarizzazione e ricattabilità, e in qualunque settore i padroni pretenderanno che ogni compito venga svolto più velocemente.

Grazie del chiarimento. La vostra discussione è molto interessante ed è a un altro livello rispetto al mio commento, che era più sulla questione banale se sia etico/sensato che l’AI produca materiale artistico. Probabilmente è solo un aspetto molto contingente dell’intera questione però forse è anche uno dei pochi punti di connessione tra l’AI e tutto quello che c’è dietro e la vita quotidiana delle persone. Poter usare questa tecnologia usare con buonsenso implica ovviamente avere consapevolezza, se non di tutte le questioni che voi ponete e che sono anche abbastanza complesse, almeno di quelle principali (impatto ambientale ad esempio), senza esserne risucchiati come accaduto coi social. Questo intendevo dire: se usata con consapevolezza può essere meno dannosa.

Tornando allo specifico della letteratura: quì sappiamo tutti che esistono già generi che si adattano perfettamente all’efficienza richiesta dal mercato: un caso su tutti di scuola di quello che potremmo definire “prodotto algoritmico” è il cosidetto “Romantasy”: serializzabile, ottimizzabile e perfettamente allineato alle logiche di “engagement”.

Ovviamente, a oggi, uno dei generi più redditizi, con vendite globali milionarie e in crescita continua (richiamando ancora Mariano Tomatis, uno dei titoli di maggior successo in Italia si intitola «La mesmerista» :))

La sua forza sta nella prevedibilità: tropi ricorrenti, climax romantico obbligatorio e “worldbuilding” standardizzato. Alla faccia di Tolkien che ha speso gran parte della sua vita a “immaginare” la Terra di Mezzo. Ora è questione di secondi.

Una tale struttura rende il genere perfetto per la produzione algoritmica: un LLM puo ricombinare pattern narrativi senza bisogno del corpo, di attingere quindi all’esperienza vissuta, generando storie perfettamente “funzionanti/funzionali” per il mercato. Un ricombinare conoscenza [nozioni aquisite in rete] continuo e veloce quanto serve, che trasforma la cultura in un processo automatizzato. Che dire: un prodotto (editoriale) perfetto.

PS: nel precedente post ho usato la parola esternalizzazioni (che non è del tutto sbagliata) ma intendevo esternalità. Sorry!

Faccio una piccola considerazione oziosa, a fronte delle immense questioni ambientali e biopolitiche che ci troviamo di fronte. Quello che mi sfugge completamente è il senso di far fare a una macchina le cose piacevoli della vita: scrivere un racconto, suonare uno strumento musicale, chiavare… Capisco far fare a una macchina la dichiarazione dei redditi, o mandare un androide all’assemblea di condominio. Ma perché rinunciare a inventarsi una storia, a costruire un sound con la band, a cavar fuori un drago da una radice trovata nel letto del fiume? Andrà a finire che l’unica cosa che continueremo a fare “a mano” sarà il lavoro di merda. Mi sa che tutto questo hype per la macchina che vive al posto nostro non è lontano dall’hype degli accelerazionisti per il lockdown, che doveva liberarci da ogni male togliendoci la gioia di vivere.

Quello che hai appena scritto me lo farei tatuare sulle chiappe.

E sì, anche per me la continuità con gli iettatori accelerazionisti e le utopie distopiche della lockdown culture è totale, anche negli espedienti a cui si ricorre nel dibattere, avanzando pseudo-obiezioni infuse di odio del vissuto corporeo. Ripropongo quanto scriveva Wolf in piena pandemia:

https://www.wumingfoundation.com/giap/2020/04/max-headroom-19-pandemia-e-societa-senza-corpi/

Non è oziosa per nulla, questa considerazione. Una gran parte del marketing della cosiddetta “IA” generativa insiste proprio sulla “democratizzazione della creatività”, secondo cui modelli linguistici, di immagini, di suono e video permetteranno a tuttə di essere artistə, in una concezione dell’arte finalizzata esclusivamente a visibilità, successo e guadagno che non differisce in nulla dalla logica dell’influencer sui social media. Una visione che è l’esatto contrario di quello che dice WM1 qui sul senso della (e su cosa chiediamo alla) letteratura. Nei discorsi degli entusiasti dell’IA, tutto il processo di studio, creazione, lavorazione, errore, fallimento, rielaborazione viene rimosso completamente, con un disprezzo dell’umano (e dell’impegno svincolato da logiche economiche) che non ha pari: il processo creativo, letterario o meno, non è solo un lavoro corporeo ma è anche lo spazio in cui si costruisce il pensiero, l’intenzione creativa e comunicativa (che alla macchina manca sempre, per sottolineare l’ovvio). Se io delego la creazione a una macchina, io non scrivo, non suono, non dipingo, non metto in funzione le capacità cognitive incarnate che sono necessarie all’espressione del mio essere umano. L’arrivo dei sistemi di “IA” sembra così voler completare il percorso di livellamento e banalizzazione della produzione culturale causato anche dai sistemi algoritmici (fenomeno che Kyle Chayka spiega bene in “Filterworld”), in cui l’obiettivo sembra essere la rimozione dell’umano dall’equazione, limitando il suo ruolo a mero consumatore di prodotti standardizzati dopo che da anni viene abituato a rifiutare la complessità, per eliminare costi e massimizzare profitti.

Ieri a un certo punto è cominciata a girare la notizia della morte di Bob Weir, the other one dei Grateful Dead, e così è successo che ho passato gran parte della giornata a guardare filmati e registrazioni di concerti dei GD. Se c’è una band che incarna fino in fondo quel che scrive qua sopra WM1 della letteratura e dell’arte in generale come forma di espressione comunitaria e vissuta coi corpi, quella band sono i Dead. C’è in rete il filmato di un concerto a San Francisco nella primavera del ’68, un concerto in strada coi Dead che suonano sopra il rimorchio di un camion, come in una street parade ma sono fermi. Non c’è nessuna separazione tra band e pubblico, e tutto intorno migliaia di persone occupano un intero quartiere, molti ballano sui tetti, venti metri sopra il marciapiede, vengono le vertigini solo a vederli. La città è brulicante di vita. Ricordo di aver guardato quel filmato anche durante il lockdown del 2020, con lacrime di rabbia. E poi, leggendo questa discussione su giap, mi è tornata in mente una conversazione che ho avuto con un tizio qualche mese fa. Il tizio diceva: i Beatles ci hanno messo dieci anni per fare dieci dischi. Con l’AI dieci dischi li fai in un pomeriggio, e con una qualità del suono molto migliore.

C’è moltissimo da imparare studiando il rapporto intenso e unico tra i Grateful Dead e la vasta, multiforme comunità che gli si era formata intorno e li seguiva in tour: la comunità Deadhead, col suo linguaggio, i suoi rituali e modi di stare insieme, i suoi mercatini, le sue fanzine e autoproduzioni, il suo inestimabile lavoro di preservazione della memoria dei concerti della band (l’archivio è qui, un diverso concerto dei Dead al giorno toglie la cupezza di torno). Se si va oltre il “pittoresco”, si scopre un tesoro di storie e di esempi.

Ho qui davanti un vecchio libro di David Shenk e Steve Silberman, Skeleton Key: A Dictionary For Deadheads (Doubleday, 1994). Collegando tra loro vari lemmi si ricavano storie complesse e istruttive. Ad esempio: Parking Lot Scene, Mega-Dead e Minglewood Town Council.

La “scena del parcheggio”, o “spettacolo prima dello spettacolo”, era l’insediamento nomade di furgoni, vecchi pullman personalizzati, roulottes, bancarelle, piccoli palchi ecc. che i Deadheads allestivano nei piazzali davanti ai luoghi dove quella sera avrebbe suonato la band. La “strada principale” del villaggio era sempre chiamata Shakedown Street, c’erano banchetti e cucine mobili di ogni tipo, c’erano compravendite ma si praticava molto anche il baratto. C’erano artisti di strada, musicanti, cuochi, maghe, gente che meditava o chiedeva firme per petizioni, ovviamente si aggiravano bagarini… Quando il concerto iniziava, il villaggio si assopiva, per risvegliarsi subito dopo l’ultimo bis, finché a una certa ora non si smontava tutto e ci si dava appuntamento al concerto dei Dead successivo, che era tipo la sera dopo a cento miglia di distanza.

“Mega-Dead” è il periodo che va dal 1987 alla morte di Jerry Garcia nel 1995. Si chiama così perché quando il singolo A Touch Of Grey inaspettatamente scalò la classifica USA, un pezzo di America mainstream scoprì la band, le folle ai concerti diventarono oceaniche, spesso i nuovi fan si dicevano “deadheads” ma non conoscevano i particolari codici di condotta di quella sottocultura, né capivano la particolare atmosfera che la band cercava di creare durante i concerti. Ci furono incidenti, nei parcheggi scoppiarono risse e addirittura tumulti, con interventi della polizia. Conseguenze del troppo successo, della troppa visibilità, di una dimensione che rischiava di omologare i Grateful Dead al resto della scena rock, rispetto a cui erano sempre stati anomali e indipendenti. A un certo punto minacciarono di non suonare più dal vivo, così i Deadheads si organizzarono per risolvere i problemi in autogestione, senza la polizia. Formarono il

“Consiglio comunale di Minglewood”. Minglewood è una località immaginaria legata alla tradizione blues, New Minglewood Blues è uno dei pezzi più famosi dei GD. A tutti i concerti del biennio 1988-1990 i Deadheads distribuirono volantini dove si leggeva:

«Coraggio, unitevi a noi. Il Consiglio comunale di Minglewood è uno stato d’animo, il nostro scopo è farci capire da quei deadheads che non rispettano le comunità che invadiamo per goderci l’esperienza di un concerto […] Nei paraggi dei concerti si vedono persone che fanno apertamente uso di droghe, urinano e defecano in pubblico, la gente si lamenta perché trova sull’uscio di casa deadheads che dormono o fanno sesso. Questo non è un comportamento responsabile da parte nostra […] Dobbiamo incoraggiarci a vicenda. Incanaliamo l’energia positiva che collettivamente generiamo, e usiamola per creare nella scena un’atmosfera più lieta, sicura e responsabile.»

Sono testimonianze di congiunzione, di prima che si fosse «iperconnessi», e più soli. Sono dimensioni a cui dobbiamo riattingere.

Il documentario del 2015 The Other One: The Long, Strange Trip of Bob Weir è bellissimo e si può vedere anche gratis su una di quelle celeberrime piattaforme che noi non linkiamo :-)

Certo che è davvero incredibile come tutto si tenga insieme in questa discussione. Non so se tuco ha tirato fuori i GD per qualche assonanza cognitiva metafisica, ma ricordo che proprio alcuni deadhead illustri misero in piedi quello che è considerato il primo forum online della storia. Si chiamava The Well e viaggiava su BBS. Nacque se non sbaglio come idea per mettere a disposizione online il Whole Earth Catalog, ma crebbe soprattutto come mezzo di connessione e discussione online tra deadheads.

Putroppo anche qui c’è una parabola che finisce male, come spesso capita se si guarda alle singole storie nell’epopea delle controculture di fine anni ’60. La grande lavatrice del riflusso ne ha disperso i rivoli, quando non li ha proprio trasformati in qualcosa di diametralmente opposto alle intenzioni iniziali. “Stay hungry, stay foolish” formula che molti pensano sia stata inventata da Jobs, in realtà è la citazione di un motto del Whole Earth Catalog. Da manifestazione di uno spirito fortemente controculturale a frasetta inspirazionale scritta sulle buste della spesa.

Amarcord finale:

The Well ancora esiste(l’ho scoperto ora) => https://www.well.com/

Numero di primavera ’69 del WEC => https://wholeearth.info/p/whole-earth-catalog-spring-1969

Ringrazio Tuco e ringrazio Andrea OLivieri per avermi segnalato questo scritto di Wu Ming 1, Ci sarebbe molto da dire e riflettere sull’artcolo, che presenta spunti molto interessanti, sui quali concordo, ma voglio qui soffermarmi sul riferimento alla comune e all’esperienza dei Grateful Dead e sulla loro valenza politica e culturale. Sono diventato Deadhead a 14 anni (ora ne ho 66) ascoltando Dark Star. Ho studiato, da Deadhead,il fenomeno politico-culturale dei Dead da anni (ho pure scritto un liberculo che si intitola Grateful Dead Economy, edito da Philopat), per analizzare come gli antisistemici o gli anti-capitalisti sono quelli che salvano il capitalismo. Se oggi esiste il capitalismo delle piattaforme e la Silicon Valley è perchè nella controcultura di fini anni ’60, nella nascita dei compuyter club di meta anni ’70 e nella cybercultura degli anni ’80 si sono sviluppate quelle innovaziuoni tecnologiche, sociali e culturali che poi sono state sussunte dalla logica del profitto e dalla logica di impresa sino a costituire la tecno-oligarchia dei Bezos, Musk, Zuckerberg, Thiel, ecc. di oggi. E’ quello che chiamo “processo di sussunzione vitale”. La domanda che oggi dobbbiamo porci oggi, ai tempi dcell’IA, credo sia la seguente: è necessario che passi un lungo tempo di dialettica per far sì che le idee antagoniste vengano catturate, manipolate, sussunte per essee nuova linfa del potere che volevano combattere? Non è che l’IA può svolgere direttamenge questo compito, nell’arte, come nella letteratura e nella vita umana, rendendoci robot lobotomizzati (come già cantavano gli Area negli anni ’70)?

Benvenuto, Andrea, e grazie. Giustissimo, John Perry Barlow che da paroliere dei Grateful Dead diventa alfiere del libertarianismo nel cyberspazio; l’«ideologia californiana» come integrazione col neoliberismo rampante degli aspetti più individualistici della controcultura Sixties… Per arrivare alla Silicon Valley di oggi si è passati anche da lì. Alla tua constatazione, più che centrata, affiancherei un caveat a beneficio di chi ci legge, su cui non dubito sarai d’accordo: c’è sempre un’eccedenza che non viene sussunta. Se la sussunzione – o il recupero, volendo usare un termine della “critica radicale”, che però rispetto a sussunzione ha connotati più moralistici – dell’esperienza vissuta da moltitudini intorno ai GD fosse stata totale, se questo processo consistesse in una spremitura completa di ogni limone di vitalità e diversità culturale, oggi un nome come «Bob Weir» significherebbe ben poco, e invece milioni di persone lo salutano come uno che ha contribuito a rendere le loro vite più piene e più belle.

Quanto alla domanda che poni, la giro a tutte e tutti.

Un po’ di rassegna stampa sul libro di Andrea Fumagalli Grateful Dead Economy:

Money In The Sky With Diamonds – Effimera (recensione)

https://effimera.org/andrea-fumagalli-money-the-sky-with-diamonds-stefano-lucarelli/

Una prassi visionaria per vite precarie – Il manifesto (intervista)

https://ilmanifesto.it/una-prassi-visionaria-per-vite-precarie

L’anarcocapitalismo e la Grateful Dead Economy – Che Fare (estratto del libro)

https://che-fare.com/articoli/grateful-dead-economy